北京车展前夕,英伟达全球副总裁吴新宙与媒体进行了一场深度交流。在吴新宙看来,物理AI是第四次工业革命的核心,而辅助驾驶恰恰是物理AI中“相对比较简单、而且真正可以大规模量产”的那一个。 黄仁勋十年前就看清楚了这条路,而吴新宙现在的任务,是把这条路铺平,让更多玩家能走上来。至于“干得怎么样”?他说,要再过一两年再看。

“我觉得对我来说,能够在英伟达这样的平台,有机会去推动全球所有的车厂走向L4,这已经是我职业生涯最好的注脚了。”

4月23日,北京车展前夕,英伟达全球副总裁吴新宙与媒体进行了一场深度交流。谈到很多同仁去到大热的机器人赛道。他笑称,不是坏事,但自己会继续扎根在辅助驾驶这场马拉松里。

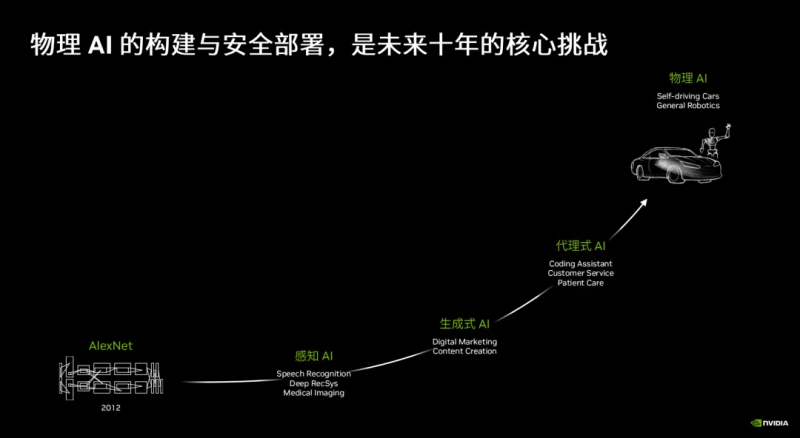

在吴新宙看来,物理AI是第四次工业革命的核心,而辅助驾驶恰恰是物理AI中“相对比较简单、而且真正可以大规模量产”的那一个。英伟达创始人兼首席执行官黄仁勋十年前就看清楚了这条路,而吴新宙现在的任务,是把这条路铺平,让更多玩家能走上来。

至于“干得怎么样”?他说,还言之过早,可以再过一两年再看。

01

“三台计算机”与“五层蛋糕”

英伟达到底要怎么做汽车业务?这是外界很关心的问题。

吴新宙给出的答案很直接:英伟达不只是一家芯片公司,而是一个“生态玩家。我们不会说一定要你用什么,我们最重要的是希望看到整个业界往前演进,而不是一定要用我们的芯片。”

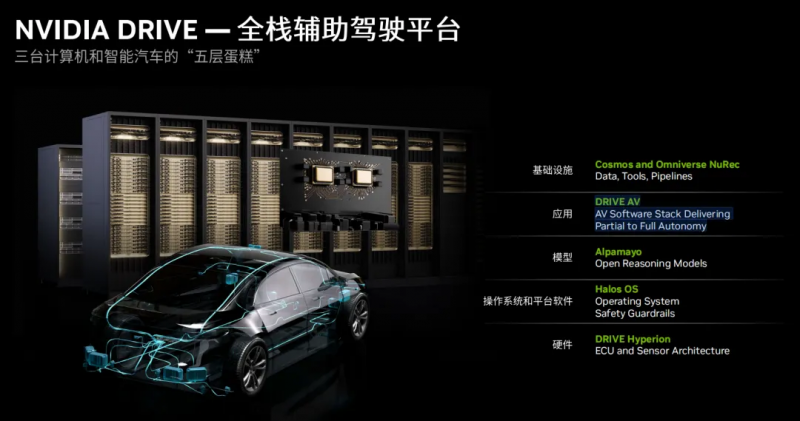

这套生态打法的核心骨架,是“三台计算机”。

第一台是车端计算机,部署在车辆上,负责实时推理。

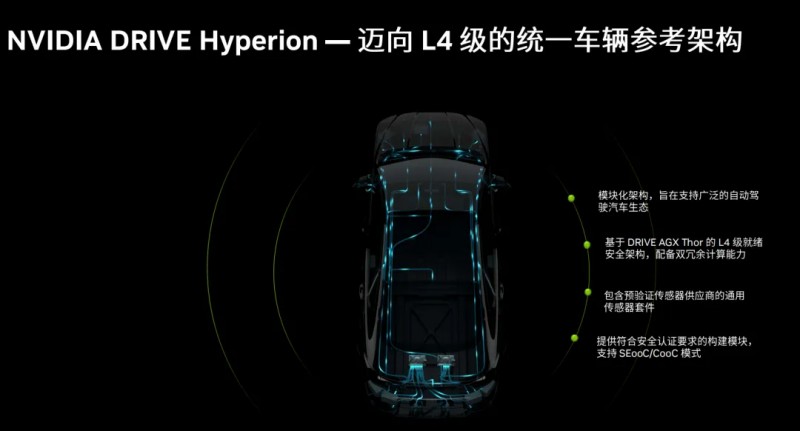

英伟达最新的Drive AGX平台已经支持FP4精度,有效算力提升至约2000 TFLOPS。针对不同需求,英伟达提供了灵活的传感器配置方案:基础型以纯视觉为主,支持L2++功能;高阶型则支持L3/L4级自动驾驶,加入激光雷达的同时,双Orin SoC实现冗余,控制器和传感器均实现双倍冗余,确保单点失效时系统能安全接管。

第二台是云端计算机,基于NVIDIA GPU,承担大模型的训练。辅助驾驶模型的训练需要海量数据和算力,这正是英伟达的传统强项。

第三台是仿真计算机,利用英伟达在图形渲染上几十年的积累,生成高保真虚拟环境,用于数据生成和验证。

吴新宙特别强调了仿真的重要性:“在端到端开发范式下,仿真成为验证新模型与旧模型对比的唯一可行方式。”英伟达的仿真技术基于NeRF进行像素级物理世界重建,支持编辑场景,可以改变天气、光照等背景,实现数据倍增。目前,英伟达每天运行约200万次仿真验证,而使用这套COTS工具,数据验证效率可以提升5-10倍。

这三台计算机闭环联动,构成了物理AI的技术底座。但吴新宙认为,光有硬件还不够。真正的门槛往往不在芯片本身,还有全套工具链。

于是,英伟达在“三台计算机”之上,进一步推出“五层蛋糕”。

第一层:硬件。提供标准化的运算平台和传感器配置,确保数据共享与互操作性。“我们把硬件的标准化做在前面,你不需要从零开始设计一套计算平台。”

第二层:操作系统与平台软件。基于Linux打造的安全操作系统,符合最高安全等级标准。DRIVE OS内置了安全机制,为开发者提供一个可靠的安全底座。

第三层:模型。这是英伟达最近重点发力的方向。

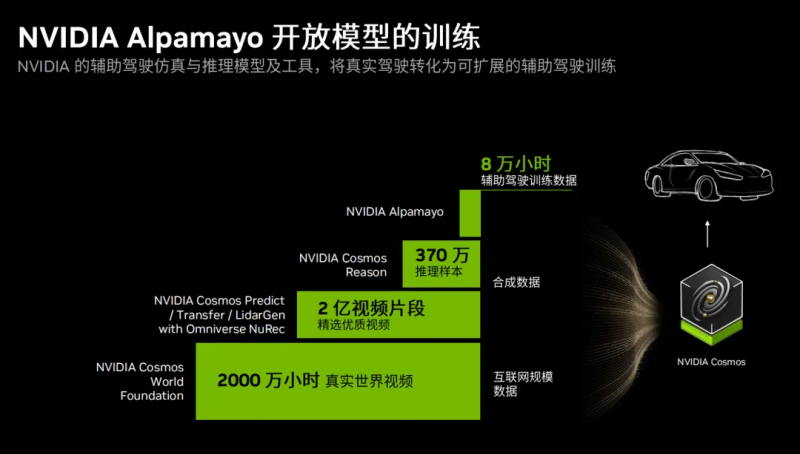

以Alpamayo为例,它基于Cosmos世界模型蒸馏而来,继承了大模型对物理世界的理解能力。吴新宙称:“我们想把基础模型给出来,帮助车企快速冷启动开发。”

目前Alpamayo用了8万小时驾驶数据进行微调,这个数据量门槛其实不算高,但继承了世界基础模型Cosmos(基于2000万小时互联网视频训练)对物理世界的理解能力。

第四层:应用。英伟达也会提供一套交钥匙的方案,即DRIVE AV,为端到端方案。“奔驰、Lucid等都会用英伟达的交钥匙方案,还有几家在谈”。

第五层:基础设施。包括云端训练和仿真工具,加速迭代闭环。在吴新宙看来,这是很多车企自己最难搭建的部分。

吴新宙特别强调,这五层并非强制绑定。他转述了黄仁勋常说的话称:“我们不希望你们买我们所有的东西,但我们不想要的是你什么东西都不要我们的。”

02

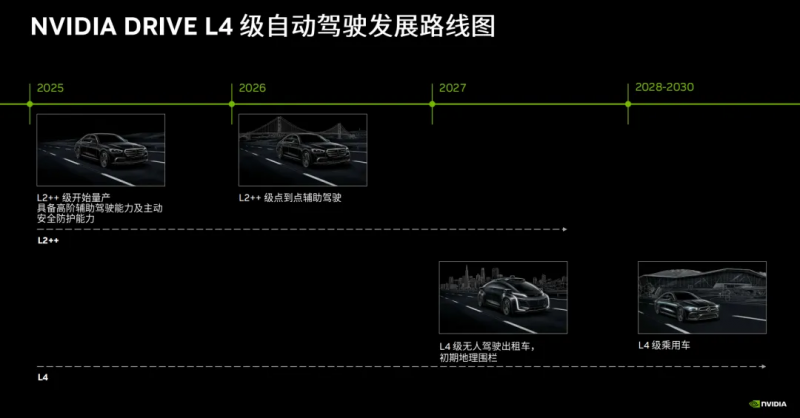

下一步要往L3、L4上迁移

全栈能力已经摆出来了,那英伟达的“车”到底跑得怎么样了?

“我们在做全球规模化落地”。吴新宙称,旧金山、洛杉矶、纽约、伦敦、首尔、慕尼黑等地都已在推进,计划明年完成全球化量产。

算法栈上,英伟达选择的是混合式端到端。端到端负责好开,即体验非常接近人类驾驶;经典算法栈并行在跑,做“兜底”作用。吴新宙称,之所以需要“兜底”,并不是模型有时候会做不安全的事情,而是作为“安全护栏,“提升整体安全感”。

下一步,吴新宙团队更重要使命是开始往L3、L4上迁移。

软件依然是两套算法,端到端和经典算法栈。但会在现有技术上进行增强,保证L3、L4要求的稳定性。

至于感知的演进,吴新宙也认为,会往世界模型的方向去走。“世界模型可能是辅助驾驶最本质的一环,它会通过物理世界的演进来决定将来要怎么来做”。在吴新宙看来,特别在L3、L4架构里,VLA和世界模型可能是并存的,两边能力互补,既要开得像人,又要绝对安全。

吴新宙称,黄仁勋一直对辅助驾驶有坚持。

他解释道:“在黄仁勋的蓝图里,物理AI非常重要。AI和物理AI一定能推动GDP十倍甚至百倍的增长。生成式AI和物理AI一定会推动第四次工业革命。”而辅助驾驶,恰恰是这盘大棋里最先落子的那一步。它比通用机器人更简单,但又足够复杂,能打磨出可规模化的技术栈。

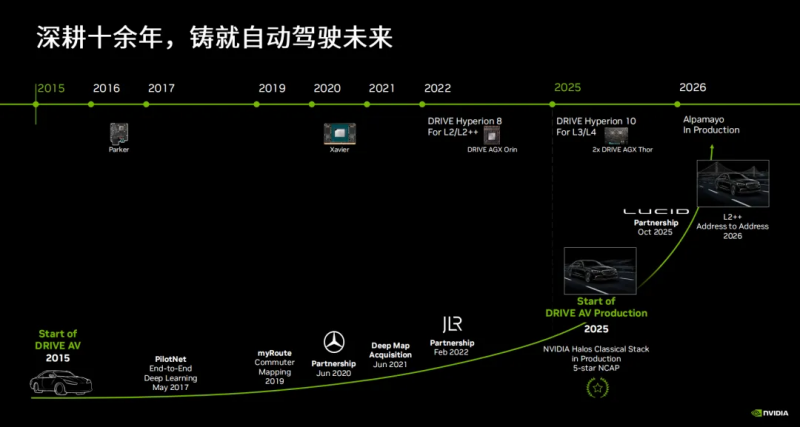

英伟达从显卡公司走到今天的AI超级战舰,靠的不是追风口,而是提前十年的预判。

那吴新宙自己呢?他的KPI就两件事:第一个是做好辅助驾驶解决方案;第二个更重要的是,服务好整个的生态圈,让越来越多的合作者能够尽快的往L4这条路上去走。

“干得怎么样?还有点言之过早,再过一两年再看吧。”但吴新宙也认为,已经比较接近L4的曙光了。“Waymo已经给大家演示了L4可以做得非常扎实”。

03

直面行业争议话题

如果说前面的内容是英伟达的“官方答案”,那么接下来则是吴新宙的“个人看法”。

关于行业一直有争议的激光雷达,吴新宙的态度是:可以证明充分性,但很难证明必要性。

“我觉得说加是不是必要,这个东西永远都是个见仁见智的问题。”他自认是“比较坚定的视觉派”。

他指出,视觉的像素密度比激光雷达高很多,特别是视觉模型出来以后,大家可以看到视觉的上限非常高。特斯拉以及其他一些车厂的实践,已经证明了纯视觉路线的可行性。

吴新宙说,在英伟达的Hyperion基础型定义中,确实不带激光雷达,以纯视觉为主。但“对于L3或L4的系统,我们是坚定地认为激光雷达是非常重要的一环,因为它可以提供传感器冗余,是确保安全的关键。”

目前在L4系统的世界模型中,英伟达正在加入激光雷达数据,结合规则系统,实现双重保障。供应链方面,英伟达也在帮助欧美市场寻找稳定的激光雷达供应商,以支持方案落地。

对于“一些车企选择自研芯片”一事,吴新宙笑称,肯定不反对。他举了个例子,“特斯拉在Parker以后用了自己的芯片,但我们也一直保持着跟特斯拉的合作。”

他反复强调一个核心理念:“我们最重要的是希望推动整个生态往前发展,而不是一定要用谁的芯片。”即使车企不用英伟达的车端推理芯片,仍然需要云端的训练计算机和仿真计算机。而英伟达的开放模型、数据工具链,同样可以为自研芯片的车企提供价值。

而在说到最近热议的要不要“跳过L3”时,吴新宙有自己的看法。

“L3和L4的技术难度差别并不大。”他指出,“L3要求驾驶员在10秒钟接管,但10秒钟里已经可以发生无穷多的事情。10秒变成60秒、变成很长时间,并没有一个巨大的差别。”

但L4有一个硬门槛,往往被忽视——云端运营能力。“L4的车有时候会卡住,远程操控能力很重要。你要卖出100万辆L4的车,每辆都要配云端接管能力,这个要求非常高。相反,这对Robotaxi公司来说,比如Uber,反而更容易实现。”

“对于用户来说,可能提供一个L3的能力,并不是一个坏的选择.特别是高速上,司机不能睡觉,但可以玩手机。L3能解放的是‘不能玩手机’痛点,已经是很好的能力”。所以他的判断是:至少短期内L3有价值,L4也没那么容易做,有可能会是并存状态。

至于辅助驾驶的人才正在流向机器人赛道,吴新宙回应时,先开了个玩笑:“我这人都没走。”

“机器人和辅助驾驶,都是物理AI非常重要的一部分。英伟达也非常看好机器人方向。”他承认国内机器人赛道确实热闹,“有点像十年前的造车新势力,现在有100多家做机器人,不管做什么,都是在为第四次工业革命做贡献,我觉得都OK。”

而他自己选择留在辅助驾驶,理由也很清晰:“在英伟达,我有机会把在中国积累的经验,通过英伟达的能力放大,真正让所有车厂走向L4。这对我来说,已经是职业生涯最好的注脚了。”

下一步,他希望在英伟达,把“三台计算机、五层蛋糕”的体系打磨得更完善,让更多玩家能以更低的成本、更短的时间,走通从L2到L4的这条路。

评论: